처음엔 신기하죠.

그런데 어느 순간부터 글이 다 비슷해집니다.

문장 길이만 길고, 읽고 나면 남는 게 없어요.

🚨그게 바로 AI 슬롭이에요.

개인 역량이 부족해서가 아니고요.

모델이 그렇게 나오기 쉬운 구조를 갖고 있어서 그래요.

오늘은 “AI 글이 반복적으로 티 나는 이유”를 구조로 이해하고,

내 작업 흐름을 어디서 끊어야 하는지까지 잡아볼게요.

🎧 글 읽기 귀찮다면 재생부터 눌러보세요.

듣고 나면 내용이 더 빨리 들어옵니다.

수익이 나는 블로그는 글 하나가 아니라 구조로 움직입니다.

👉 전체 전략과 연결 구조는 “키워드 조사를 대체하는 디스커버리 엔진 구축법“에서 먼저 정리했습니다

빠르게 찾아보기

AI 슬롭은 실력 문제가 아니라 생성 구조 문제

AI가 글을 “이해해서” 만드는 것 같지만, 실제로는 다음 단어를 맞히는 게임에 더 가깝습니다.

- 가장 안전한 다음 단어.

- 가장 흔한 연결 문장.

- 가장 많이 본 결론 패턴.

🚨이걸 계속 고르다 보면 자연스럽게 평균으로 수렴해요.

예전에 학교에서 “무난하게 써라”라는 피드백을 받으면,

특징이 사라지고 교과서 같은 글이 되잖아요.

그 느낌이 자동으로 발생하는 구조라고 보면 됩니다.

그래서 AI 슬롭은 “게으르게 써서”가 아니라,

“무난함이 보상받는 시스템”에서 나오는 결과물에 가깝습니다.

여기서 중요한 행동 포인트가 하나 있어요.

초안 단계에서 무난함을 허용하면,

그 뒤 편집으로는 고유함을 되살리기 어려워요.

초안부터 방향을 바꿔야 합니다.

평균으로 끌어당기는 확률 최적화가 클리셰를 만든다

모델은 확률이 높은 표현을 좋아합니다.

“따라서”, “결론적으로”, “전반적으로” 같은 문장들이 계속 나오는 이유가 여기 있어요.

사람이 보기엔 성의 있어 보이죠.

하지만 내용이 아니라 연결어가 글을 끌고 가는 순간, 밀도가 떨어집니다.

이때부터 AI 슬롭 특유의 냄새가 나요.

✋당장 이렇게 바꿔보세요.

초안을 받았을 때, 연결어부터 지웁니다.

그리고 문장을 이렇게 재조립해요.

- 결론 문장을 먼저 둔다

- 근거를 한 문장으로 붙인다

- 예외를 한 줄로 추가한다

이 3줄만으로도 “무난한 글”이 “의견이 있는 글”로 바뀝니다.

핵심은 문장 장식이 아니라, 주장 구조예요.

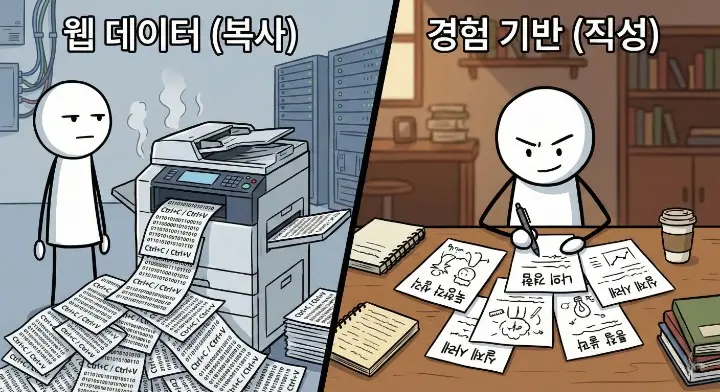

데이터 중복이 많을수록 출력도 복제처럼 변한

웹에서 긁어온 학습 데이터에는 중복이 많습니다

너무 많아요.

이 정도면 모델 입장에서는 “이 문장 패턴이 정답”처럼 각인되겠죠.

Deduplicating Training Data Makes Language Models Better라는 분석에서 이런 중복 편향을 정리해둔 걸 보면 감이 옵니다.

이 구조가 콘텐츠 제작에서 어떤 문제를 만들까요.

“다들 하는 말”이 더 강하게 학습돼서,

“내가 겪은 말”이 초안에서 밀려납니다.

그래서 행동은 이렇게 가야 해요.

초안 요청 전에, 재료를 먼저 넣는 방식으로요.

💡예를 들면 이런 겁니다.

- 내가 겪은 실패 1개를 2줄로 적기

- 그 실패를 바꾼 기준 1개를 1줄로 적기

- 독자가 따라 할 행동 1개를 1줄로 적기

이걸 넣고 생성하면, 모델이 “중복된 웹 패턴” 대신

“당신이 준 재료”를 중심으로 문장을 짜게 됩니다.

AI 슬롭은 보통 재료가 없을 때 더 빠르게 생겨요.

👉이 부분은 “경험 없는 글은 왜 바로 티가 날까” 글에서 실제 사례 기준으로 정리해뒀습니다.

RLHF가 길이를 보상하면서 군더더기가 늘어난다

사람이 평가할 때, 긴 답변을 더 성의 있다고 느끼는 경향이 있죠.

그래서 RLHF 과정에서 “길이 편향”이 생기기 쉽습니다.

Disentangling Length Bias In Preference Learning Via Response-Conditioned Modeling 같은 연구에서도,

선호 학습이 내용의 질보다 길이에 보상을 주는 문제를 다룹니다.

🚨이게 실전에서는 이렇게 보입니다.

- 말은 많은데 결론이 늦게 나온다

- 불렛이 많아 보이지만 새 정보가 없다

- 정의를 반복하고, 예시는 없다

즉, 길어지는 게 문제가 아니라 “길어지는 방식”이 문제예요.

여기서 바로 적용할 수 있는 편집 규칙을 하나만 가져가세요.

문단마다 ‘새 정보 1개’가 없으면 삭제합니다.

잔인하게 느껴져도, 이게 제일 빨라요.

💡그리고 남은 문단은 이렇게 바꿔요.

- 첫 줄: 결론

- 둘째 줄: 근거

- 셋째 줄: 독자가 할 행동

이러면 같은 분량이어도 밀도가 달라집니다.

지침을 이해해도 실행이 흔들리는 구조가 있

AI가 “원칙 설명”은 잘하는데,

막상 “그 원칙대로 결과물”을 못 만들 때가 있죠.

이게 단순 실수가 아니라 구조적 한계로 설명되기도 합니다.

Comprehension Without Competence: Architectural Limits of LLMs in Symbolic Computation and Reasoning에서는

지침을 이해하는 경로와 실행 경로가 분리되어 생기는 문제를 다룹니다.

실제로 써보면 이런 장면이 나와요.

🚨“중복 표현 줄여줘”라고 했는데,

다른 중복을 새로 만들어서 돌아오는 경우에요.

이때 필요한 건 프롬프트를 더 길게 쓰는 게 아닙니다.

작업을 두 단계로 쪼개야 해요.

아예 역할을 분리하는 거죠.

아래 표처럼요.

| 단계 | AI에게 시키는 일 | 사람이 하는 일 |

|---|---|---|

| 1차 | 구조 잡기, 주장-근거-예외 뼈대 만들기 | 내 경험/사례 1개 꽂기 |

| 2차 | 문장 다듬기, 길이 줄이기 | 과장 제거, 톤 통일 |

| 3차 | 제목/첫 문단만 재작성 | 클릭 유도 표현 점검 |

이렇게 가면 AI 슬롭이 생길 구간이 줄어듭니다.

AI가 강한 구간과 약한 구간을 인정하고,

약한 구간은 사람이 짧게 잡아주는 방식이에요.

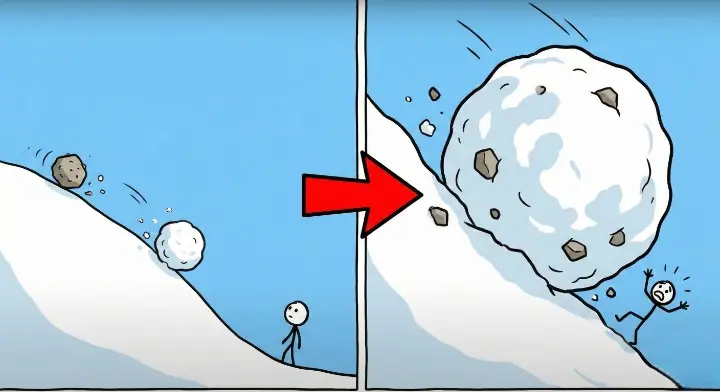

노출 편향 때문에 작은 실수가 눈덩이처럼 커진다

생성 모델은 글을 쓸 때,

직전에 자기가 만든 문장을 다음 문장의 재료로 씁니다.

처음에 한 번 어긋나면, 그 어긋남이 계속 누적돼요.

그래서 초반에 “정의가 애매한 단어”를 쓰면,

뒤로 갈수록 문장이 더 공허해집니다.

이게 AI 슬롭이 중반부터 갑자기 심해지는 이유 중 하나예요.

여기서 행동은 간단해요.

🔥초반 5줄을 사람이 고정해주는 겁니다.

- 문제를 한 줄로 못 박기

- 독자가 원하는 결과를 한 줄로 못 박기

- 이 글의 기준을 한 줄로 못 박기

- 예외를 한 줄로 못 박기

- 오늘 할 행동을 한 줄로 못 박기

이 5줄이 있으면,

모델이 헛소리로 도망갈 공간이 줄어듭니다.

추론 모델은 반복 루프에 빠지면서 슬롭을 폭발시킨다

요즘 추론형 모델에서 가끔 보이는 현상이 있어요.

같은 문장을 변주만 하면서 계속 늘어놓는 것.

“결국 핵심은…”을 다섯 번 말하는 식이죠.

Looping in Reasoning Models를 다룬 분석에서는,

특정 조건에서 루핑 발생률이 4%를 상회한 실험도 언급됩니다.

이건 사용자가 “더 깊게”를 요구할수록 더 잘 터집니다.

깊게가 아니라, 길게로 오해하고 달려버리거든요.

이때는 요청을 이렇게 바꿔야 합니다.

“더 깊게” 대신 “더 좁게”로요.

💡예를들어 이런 식입니다.

- “이 주제에서 사람들이 제일 많이 착각하는 1가지만”

- “반대 사례 1개만 들고, 왜 실패했는지”

- “내가 바로 적용할 체크 포인트 3개만”

좁히면 루프가 줄어듭니다.

그리고 결과물도 덜 평범해져요.

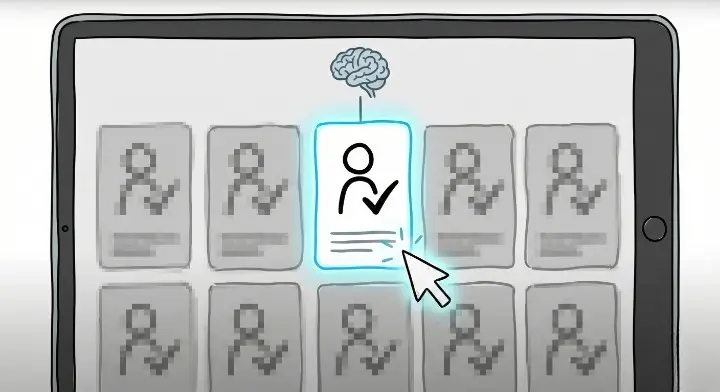

AI 검색 시대에는 슬롭이 노출 자체를 깎아먹는다

요즘은 검색이 “링크 나열”에서 끝나지 않죠.

AI가 요약해서 보여주고, 추천으로 트래픽이 갈립니다.

그런데 AI 슬롭 스타일 글은 여기서 손해를 봐요.

이유는 단순합니다.

🚨요약할 만한 고유 정보가 없거든요.

이게 콘텐츠로 오면 이렇게 됩니다.

“그럴듯한 이유”를 줄줄 말하는데,

정작 “왜 그 행동을 해야 하는지”가 비어 있어요.

AI 추천 시스템 입장에서도,

뾰족한 신호가 없는 글은 “어디에 붙여도 무난한 글”이 됩니다.

그러면 추천에서도 밀리기 쉬워요.

그래서 지금 필요한 건 한 가지예요.

✋요약이 아니라 인용될 문장을 만들기.

💡문단마다 한 줄씩, 이런 문장을 의도적으로 박아두세요.

- “이 글의 기준은 한 가지예요. OO가 없으면 슬롭입니다.”

- “OO를 넣지 않으면, AI는 평균으로 돌아갑니다.”

- “여기서 갈립니다. OO를 먼저 고정하세요.”

이 한 줄이 AI 요약에서 살아남는 문장이 됩니다.

AI 슬롭 끊는 편집 체크리스트

- 첫 문단 5줄은 사람이 직접 고정한다✔️

- 문단마다 새 정보 1개 없으면 삭제한다✔️

- 연결어를 먼저 지우고 주장-근거-예외로 재조립한다✔️

- “더 깊게” 대신 “더 좁게”로 재요청한다✔️

- 내 경험 1개를 초안 재료로 먼저 넣는다✔️

FAQ

Q. 초안이 너무 무난하게 나오는데, 프롬프트를 더 길게 쓰면 해결되나요?

보통은 반대예요.

길게 쓰면 모델이 안전한 문장으로 채우기 쉬워요.

재료 4줄을 먼저 주고, 출력은 짧게 제한하는 쪽이 효과가 큽니다.

Q. 불렛 포인트가 많으면 AI 슬롭이 더 심해지나요?

불렛 자체가 문제는 아니고, 불렛이 “새 정보 없이 길이만 늘리는 도구”로 쓰일 때 심해져요.

불렛 1개당 새 정보 1개 규칙을 걸어두면 확 줄어듭니다.

Q. 같은 문장을 반복하면서 루프에 빠질 때는 어떻게 끊나요?

“더 자세히”를 멈추고 범위를 좁혀야 해요.

반례 1개, 실수 1개, 체크 포인트 3개처럼 출력 형태를 제한하면 루프가 끊깁니다.